Em intervenção nesta quinta-feira (03/10), organização abordou o uso de recursos de reconhecimento facial na segurança pública.

Durante intervenção no debate do Grupo de Trabalho sobre pessoas afrodescendentes no 57º período de sessões do Conselho de Direitos Humanos das Nações Unidas, a Justiça Global apresentou resultados racistas de ferramentas de inteligência artificial, com destaque ao uso de reconhecimento facial na segurança pública do Brasil.

Para a organização, o uso dessas ferramentas sem adequada regulamentação têm contribuído para aumentar o encarceramento em massa da população negra, gerando constrangimentos, prisões arbitrárias e violações de direitos humanos.

Assista na íntegra:

Segundo relatórios produzidos pela Defensoria Pública do Rio de Janeiro (DPRJ) e pelo Colégio Nacional de Defensores Públicos Gerais (Condege), entre 2012 e 2020 ocorreram 90 prisões injustas por reconhecimento fotográfico, sendo 73 na cidade do Rio de Janeiro. Do total, 79 encarceramentos traziam informações sobre o perfil racial dos acusados, revelando que 81% deles eram pessoas negras.

“Apesar de diretrizes da ONU publicadas em 2022 definirem que as imagens de monitoramento não devem ser usadas como provas, o princípio da autonomia das polícias brasileiras permite que as imagens sejam usadas para decretar a prisão preventiva. Dessa forma, a ampliação dessa tecnologia continua sendo feita, ainda que não se tenham regulamentações estaduais e federais”, observou Luna de Oliveira Ribeiro, pesquisadora no programa de violência institucional e segurança pública da Justiça Global.

O viés racista do reconhecimento por fotografias pela polícia – frequente e ilegalmente usado como única prova – não é novidade, mas com as novas tecnologias de inteligência artificial, esse problema ganha uma nova etapa.

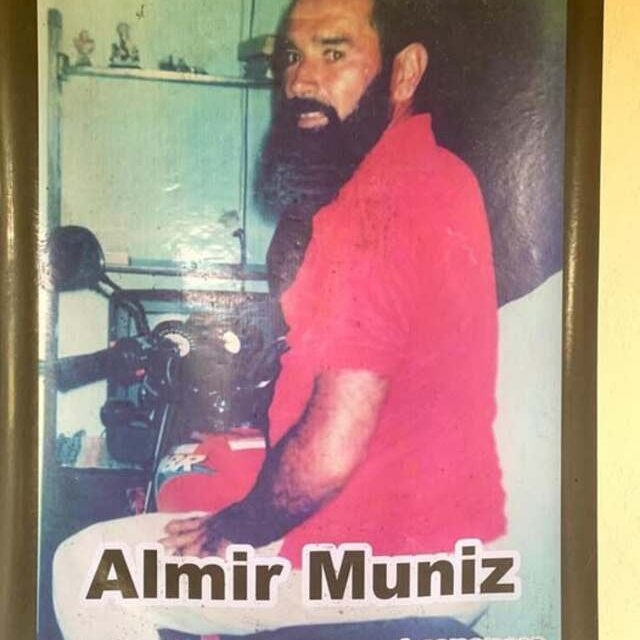

Uma reportagem especial da Agência Brasil mostrou os impactos psicológicos dos diversos casos em que pessoas negras foram acusadas de crimes injustamente após uso de fotografias.

Ao veículo, o pesquisador e autor do livro Racismo Algorítmico: Inteligência artificial e discriminação nas redes digitais Tarcízio Silva destaca que o funcionamento desses sistemas cria padrões de quem é suspeito ou não a partir de registros já existentes nos sistemas criminais, como as fotografias.

Falta de transparência

Conforme o Cesec (Centro de Estudos de Segurança e Cidadania), a Bahia é o estado com maior número de prisões por meio do sistema de reconhecimento facial. 1.523 pessoas já foram presas desde que a tecnologia começou a ser usada no estado, em 2019.

Entre 50 iniciativas analisadas até o momento pelo O Panóptico, projeto do Cesec, 70% têm índice de transparência inferior a 4, em uma escala de 0 a 10. Ao todo, são 282 programas de reconhecimento facial em atividade no país. Falta de identificação de empresas fornecedoras, operadoras ou do órgão responsável pela licitação, além da falta de informação sobre como a tecnologia foi adquirida e o custo total dos sistemas estão entre as falhas listadas.

“Os pesquisadores afirmam ainda que prefeituras e estados negaram o emprego de tecnologias de reconhecimento facial, apesar de indícios e documentos indicarem o contrário”, mostrou reportagem do O Globo sobre a pesquisa.

Foto da capa: Divulgação do documentário ‘Coded Bias’/Netflix.